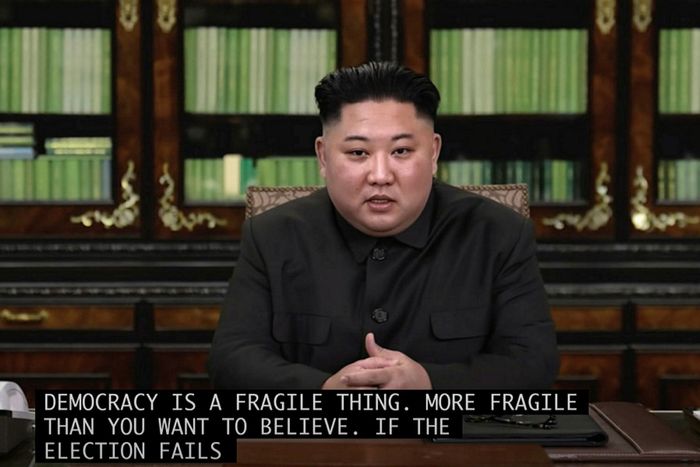

英国女王伊丽莎白(Queen Elizabeth)从未在一年一度的圣诞致辞中加入舞蹈表演,朝鲜独裁者金正恩(Kim Jong Un)此前也从未警告美国人“民主是脆弱的”,但在去年疯传的视频中,他们却似乎就是这么做的。

这两条视频,以及成千上万条类似视频,都是“深度伪造”(Deepfake)的产物。深度伪造利用人工智能生成静态人脸,伪造政治人士和名人的言论和行为。

尽管许多深度伪造视频的目的是为了产生戏剧性或冲击性效果,并无意误导观众,但这类视频已经成为了传播虚假信息的工具。

在一段疯狂传播的深度伪造视频中,“金正恩”在鼓励美国人出来投票

在一段疯狂传播的深度伪造视频中,“金正恩”在鼓励美国人出来投票卡内基国际和平基金会(Carnegie Endowment for International Peace)“网络政策倡议”(CPI)研究员乔恩•贝特曼(Jon Bateman)表示:“深度伪造的独特之处在于,视听元素对我们心理产生的影响比其他类型的媒体更大。”

原则上,人工智能可以将媒体编辑和处理的过程自动化,让任何人都可以使用这种技术,但这种骗术需要大量的训练数据和技术能力。其他更简单的攻击目标或影响公众舆论的方法更易带来回报。

您已阅读23%(485字),剩余77%(1669字)包含更多重要信息,订阅以继续探索完整内容,并享受更多专属服务。